Ce que font Lemrock et Sumbia,

et ce qu'on fait différemment. 🎯

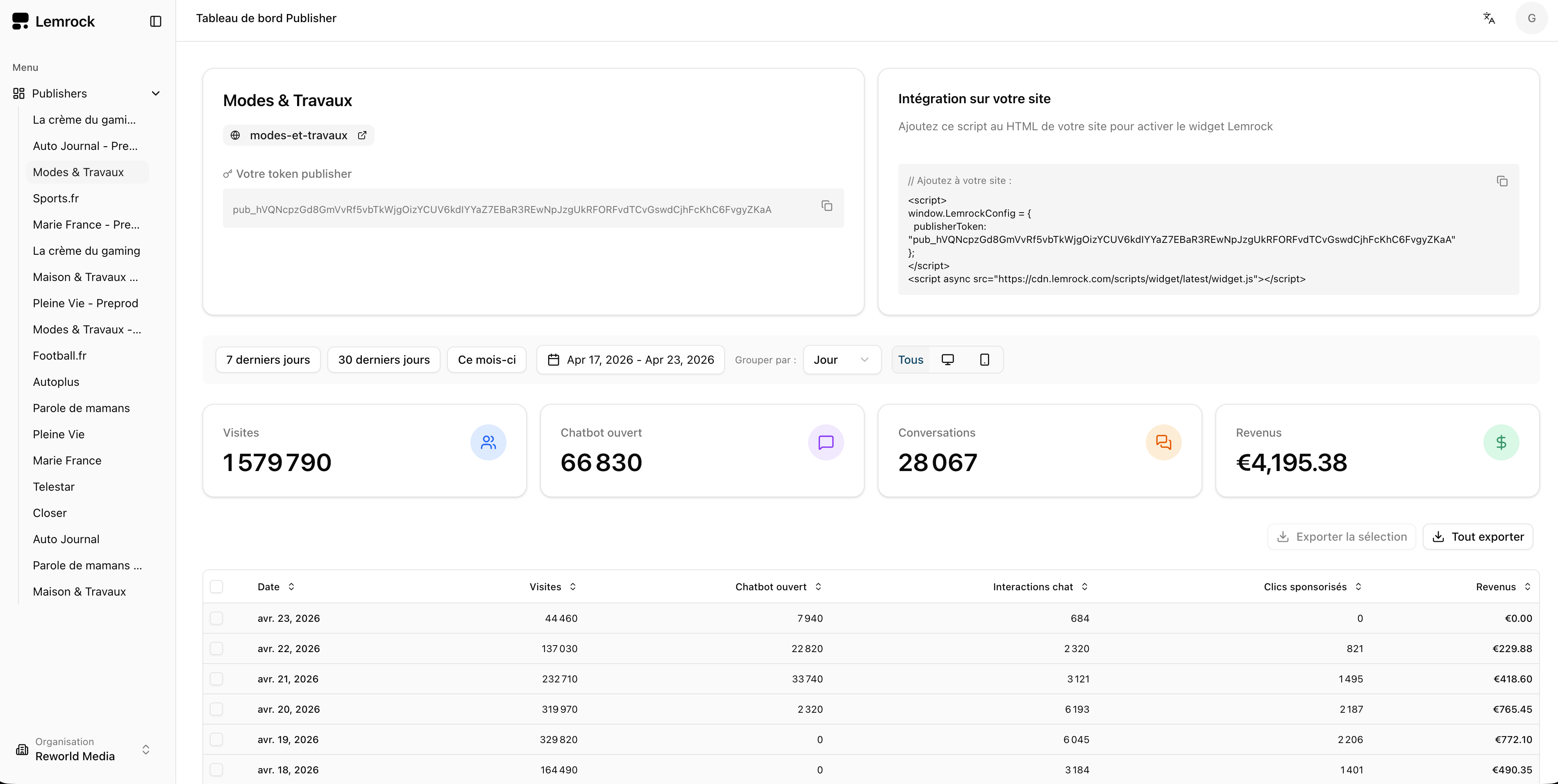

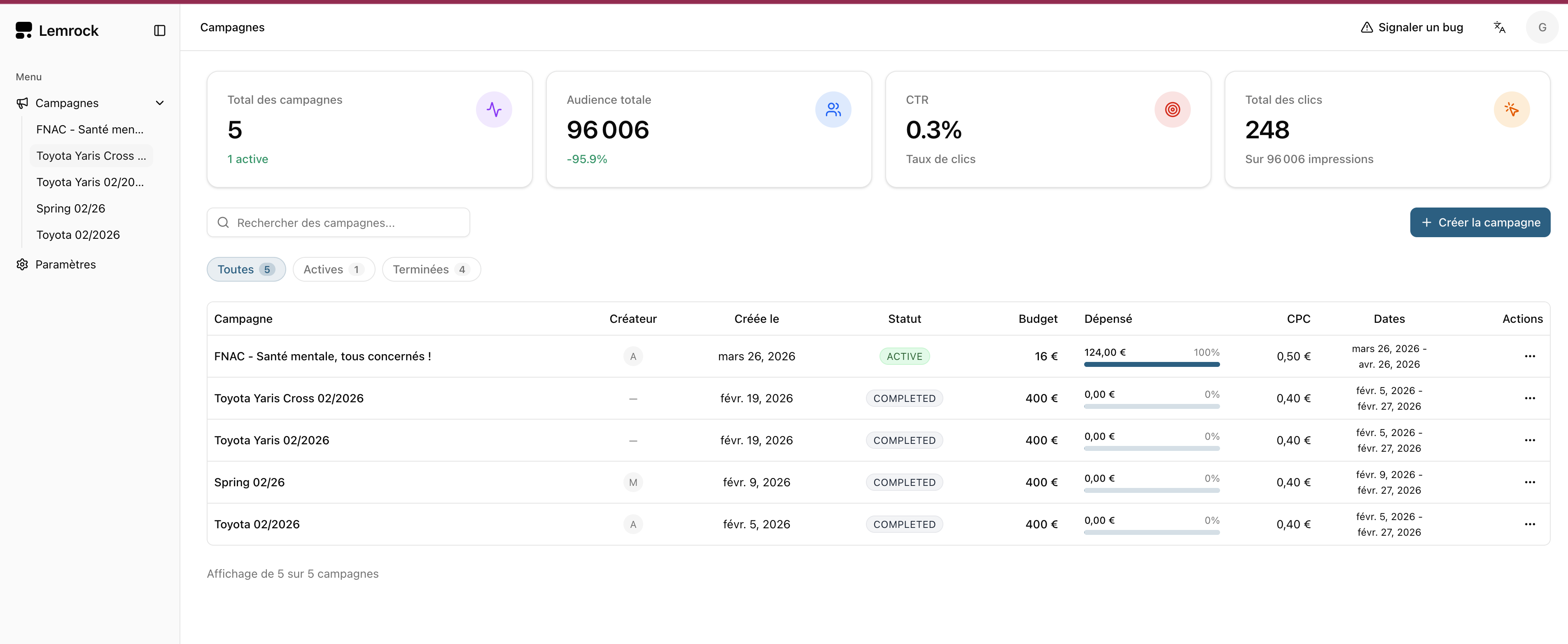

Lemrock

Ce qu'ils font bien. Widget chat, console publisher, console advertiser (campagnes CPC, budgets, ciblage).

Ce qu'on garde. La structure de campagne — standard du marché.

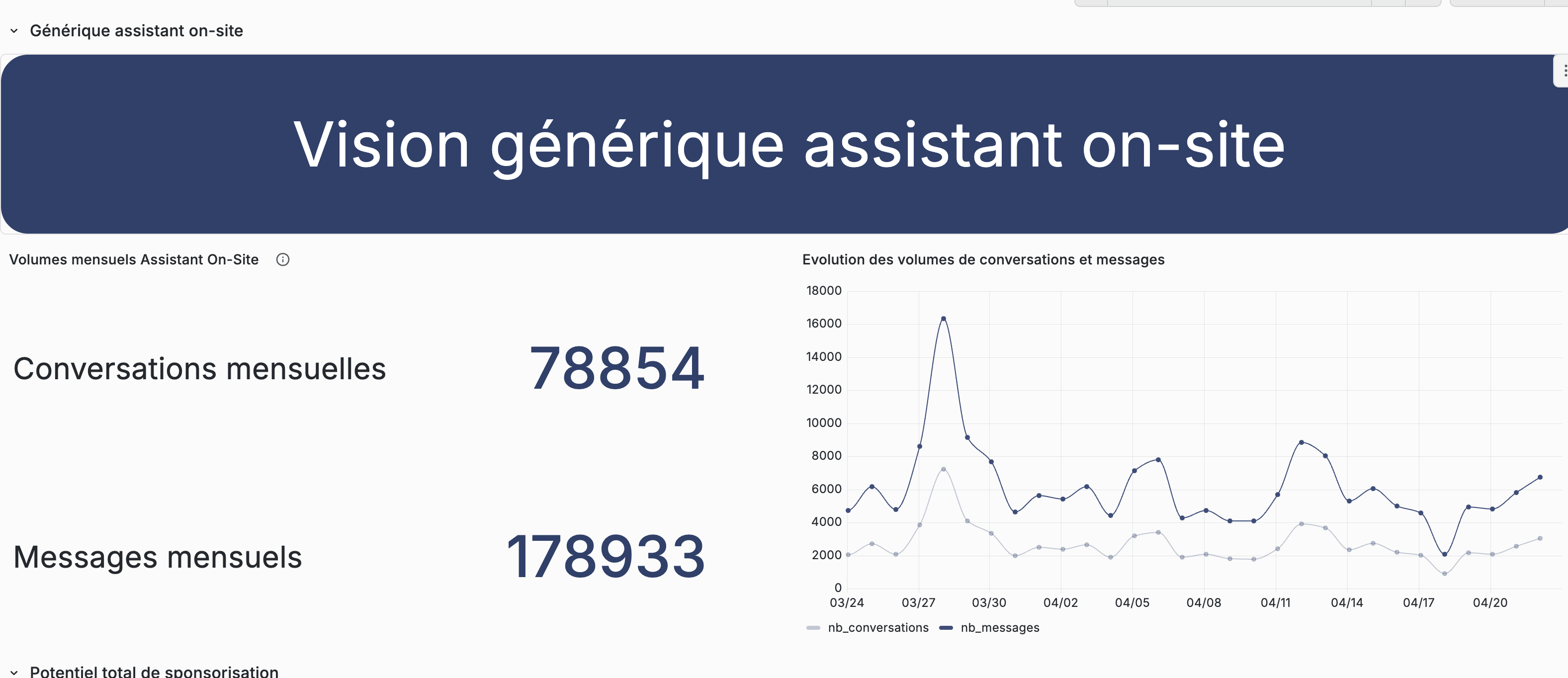

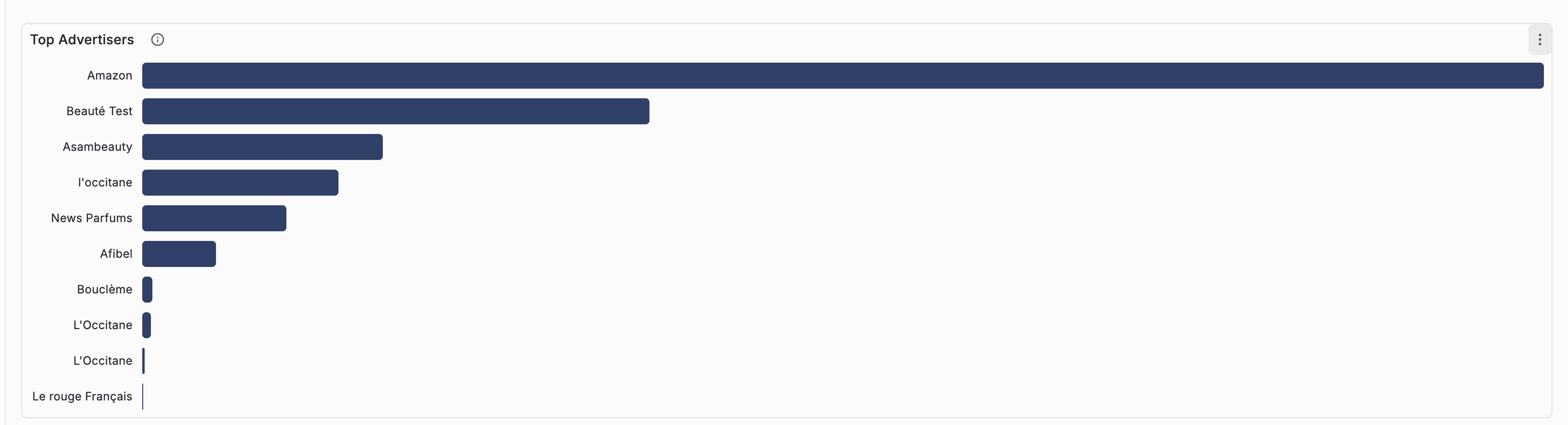

Sumbia

Ce qu'ils font. Analytics Grafana — mais en mieux, leur dashboard est horrible. Complexe, peu friendly, impossible à présenter à un annonceur.

Ce qu'on garde. La granularité des métriques. Ce qu'on refait — l'UX, de zéro, dans RMR.